ニュース / News

ニュースリリース

AIにより生成されたフェイク顔映像を自動判定するプログラム SYNTHETIQ: Synthetic video detectorを開発

~AI動画の生成、フェイクメディアの検知、メディアの信頼性確保の研究を推進~

大学共同利用機関法人情報・システム研究機構 国立情報学研究所(NII、所長:喜連川 優、東京都千代田区)のシンセティックメディア国際研究センター長の越前 功と副センター長の山岸 順一の研究チームはDeepfakeに代表されるAIにより生成されたフェイク顔映像を自動判定するプログラム「SYNTHETIQ: Synthetic video detector」を開発しました。本プログラムは、判定対象となる映像のアップロードから、判定結果を示した映像をダウンロードするまでの全てのプロセスをウェブAPIとして利用可能なものです。このウェブAPIの活用により、AIを活用したウェブサービス「AI as a service, AIaaS」を容易に実現できると期待されます。

本研究成果は、科学技術振興機構(JST、理事長:濵口 道成、東京都千代田区)の戦略的創造研究推進事業の「CREST VoicePersonae: 声のアイデンティティクローニングと保護(研究代表者 山岸順一)」、「CREST インフォデミックを克服するソーシャル情報基盤技術(研究代表者 越前 功)」、およびJST 研究成果最適展開支援プログラム A-STEP(トライアウト)の「 AIにより生成された顔映像フェイクメディアを検出する技術の確立(研究代表者 越前 功)」のもとで開発されました。

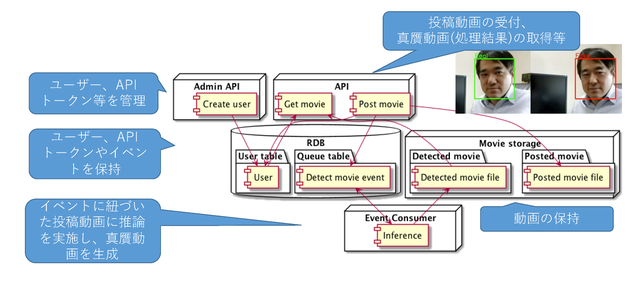

<図1>SYNTHETIQの概要

顔、音声、自然言語などの人間由来のデータを大量にAIに学習させることで、本物と見紛う顔映像、音声、文章といった「シンセティックメディア」の生成が技術的に可能となりました。このような技術には私たちの社会を豊かにする活用方法も多く考えられますが、悪用された場合には詐称や情報操作などが起きる可能性もあります。とりわけ、映像中に映りこんだ顔を他人の顔に置き換えたDeepfake映像が、現在では社会的に問題になっています。

NIIではDeepfake映像に対して真贋判定を行う深層学習モデルを研究してきました(*1)(*2)(*3)。判定方法は、人間による分析等を一切必要としない、大量のデータに基づく自動識別手法です。そのため、圧縮やダウンコンバージョンなどのメディア処理が施されていても、一定の信頼度をもって判定を行うことが可能です。

しかし、本技術を利用するためには複数の高度な深層学習技術を利用する必要がありました。そこで、他のアプリケーションにおいても本技術を容易に導入できるように、真贋判定を行う映像をサーバにアップロードし、判定結果を示した映像をダウンロードするまでの全てのプロセスをウェブAPIとして利用可能なプログラム「SYNTHETIQ」を開発致しました。このウェブAPIを活用すれば、AIを活用したウェブサービス「AI as a service, AIaaS」を容易に実現できると期待されます(*4)。

NIIシンセティックメディア国際研究センターでは、SYNTHETIQの社会実装を推進するため、パートナーとなる企業を募集しています。

研究プロジェクトについて:

本研究はJST 戦略的創造研究推進事業 CREST VoicePersonae: 声のアイデンティティクローニングと保護(JPMJCR18A6)、CREST インフォデミックを克服するソーシャル情報基盤技術(JPMJCR20D3)、およびJST 研究成果最適展開支援プログラム A-STEP(トライアウト) AIにより生成された顔映像フェイクメディアを検出する技術の確立(JPMJTM20LQ)の一環で行われました。

関連リンク

ニュースリリース(PDF版)

- (*1)D. Afchar, V. Nozick, J. Yamagishi, and I. Echizen, "MesoNet: a Compact Facial Video Forgery Detection Network," Proc. of the IEEE International Workshop on Information Forensics and Security (WIFS 2018), 7 pages, December 2018

(https://doi.org/10.1109/WIFS.2018.8630761) - (*2)Huy H. Nguyen, Junichi Yamagishi, and Isao Echizen, "Capsule-forensics: using capsule networks to detect forged images and videos," Proc. of the IEEE International Conference on Acoustics, Speech, and Signal Processing (ICASSP 2019), 5 pages, May 2019

(https://doi.org/10.1109/ICASSP.2019.8682602) - (*3)Huy H. Nguyen, Fuming Fang, Junichi Yamagishi, Isao Echizen, "Multi-task Learning For Detecting and Segmenting Manipulated Facial Images and Videos," Proc. of the IEEE International Conference on Biometrics: Theory Applications and Systems (BTAS 2019), 8 pages, September 2019

(https://doi.org/10.1109/BTAS46853.2019.9185974) - (*4)本プログラムを活用したサービスを展開可能な企業に、契約締結に基づきライセンスすることを想定しています。

国立情報学研究所 研究教育職員 募集

国立情報学研究所 研究教育職員 募集 NII Today No.107

NII Today No.107 学術情報基盤オープンフォーラム 2026

学術情報基盤オープンフォーラム 2026 国立情報学研究所 2026年度 概要

国立情報学研究所 2026年度 概要 情報研シリーズ 「ディープフェイク 生成AIとの共棲に向けて」

情報研シリーズ 「ディープフェイク 生成AIとの共棲に向けて」 NIIサービスニュース

NIIサービスニュース SINET広報サイト

SINET広報サイト ウェブサイト「軽井沢土曜懇話会アーカイブス」を公開

ウェブサイト「軽井沢土曜懇話会アーカイブス」を公開 SINETStream 事例紹介:トレーラー型動物施設 [徳島大学 バイオイノベーション研究所]

SINETStream 事例紹介:トレーラー型動物施設 [徳島大学 バイオイノベーション研究所] 学術研究プラットフォーム紹介動画

学術研究プラットフォーム紹介動画