Interview

AIの裁判への導入は「期待」と「不安」と

人工知能(AI)活用の現状と課題

司法分野へのAIの応用は海外で先行しており、国内でも今後、実用化へと進む可能性が高い。 司法をより利用しやすくするために、AIはどのように機能するのだろうか。 この領域の研究に長く携わってきた太田勝造教授と新田克己教授が語り合った。

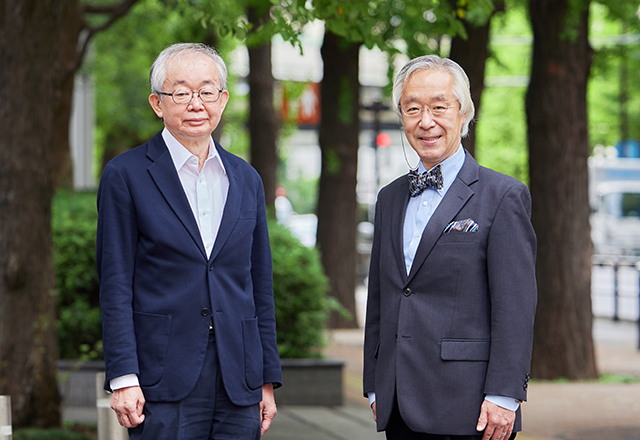

太田 勝造氏OTA, Shozo

明治大学法学部 教授

東京大学 名誉教授

弁護士

民事訴訟法研究者として名古屋大学法学部で教鞭をとった後、東京大

学法学部で法社会学を担当。AIと法、法と経済学、ニューロ・ロー、法と交渉、法と統計学、裁判外紛争解決、弁護士論、民訴法、法と進化ゲーム理論などの学際的研究に従事している。近編著に『AI 時代の法学入門』弘文堂 2020 年がある。

新田 克己NITTA, Katsumi

東京工業大学 名誉教授

同大 情報理工学院 特任教授

国立情報学研究所

情報学プリンシプル研究系 特任教授

聞き手井田 香奈子 氏IDA, Kanako

朝日新聞 論説委員

東京大学(東大)社会心理学科卒業後、朝日新聞社へ。在勤中の 2012年東大情報学環修士課程(社会情報学)修了。新聞社では社会部、ブリュッセル支局長を経て、現在は司法関連の社説を担当している。著作に「裁判員制度の評議と報道」(マス・コミュニケーション研究82号)など。

――これまでの司法は人間である法律家の関与が前面に出ていて、AIとの接点を意識することはあまりなかったのが実感です。AIを導入する研究はどのように進展してきたのでしょうか。

新田 海外では欧米を中心に1970年代から、法律の知識をもち、法律家の補助をするコンピュータプログラムが開発されてきました。これは「法律エキスパートシステム」として知られ、日本でも80年代から法律エキスパートシステムプロジェクトが立ち上がりました。

太田 法論理学の発展系として始まり、80年代初めから私も法学者として参加しましたが、当時、法律家の関心は高いとはいえませんでした。新しい情報や経験をえながら、予測の精度を上げていく、いまでは当たり前のベイズ意思決定論やベイズ統計学でさえ当時は異端でした。

新田 最初の段階の法律エキスパートシステムは法令をコンピュータが理解できるルールに変換し、法律相談の結論を出すものでしたが、次に判例も参考にして結論を出すように進歩してきました。近年は判例データベースを機械学習することで判決予測の精度を高められないか、という具合に進歩してきました。法律家が求めるのは、自分の頭の中にないような難しいレベルの判断ができる機能ですが、そこまでの機能を持つシステムはまだ存在しないと思います。

――司法への応用ならではの難しさはどんなことですか。

新田 まず、ルールの体系をつくることが大変です。機械は日常用語や一般常識のような外界の情報を知りません。法令の中だけでルールをいくらつくっても、外界のルールがなければ現実の問題に当てはめようとすると足りません。不法行為、過失など様々な法律用語もその認定範囲がケース・バイ・ケースで異なり、判断が難しいのです。

深層学習で精度の高い判断

――近年の深層学習の進展で、どんな影響がありましたか。

新田 大量の文書データを詳細に分析でき、より精度の高い法律判断が可能になってきました。さらに契約文書をチェックしたり、過去の裁判を参照して顧客に詳細な助言を与えるなどの高度なサービスにもつながります。こうした「リーガルテック」は実用化が進んでおり、日本でも数十の法律事務所が何らかの形で導入しているといわれています。ただし、裁判において無制限に先端技術の活用を進めていいのか、倫理的な問題もあります。たとえば裁判員裁判でどんな属性の人が合議体に入ると有利になるかをシミュレーションすることも、技術的に可能になってきましたが、それは裁判の公正に照らしてどうなのか、といった問題もあります。

太田 米国では、陪審員選任手続きでどのような人を選び、どのような人を忌避すべきか、高いお金をとって助言する会社がありますね。社会調査などによって自分の側に有利な陪審員のタイプを選び出そうという戦略です。日本の裁判員裁判でも、検察側と弁護側がそれぞれ4名を理由無しで排除できます。依頼者の利益を最大化することが弁護士の役割であり、ルールの範囲内でやれることをやることは必要だと思います。他方、判決予測のシステムについては、フランスが個別の裁判官についての判決予測を禁止する法律をつくって話題になりました。ただ、その法律によって、当事者名を匿名化した上での判決情報の公開は、むしろ進められています。

――今年の通常国会で、民事裁判手続きをIT化する法改正がなされましたが、影響はありますか。

新田 訴状や判決など従来は書面で処理されていたものが電子化され、裁判が効率化されます。また、研究者が扱えるデータ量は大幅に増えるのではないかと期待しています。

太田 なぜここまで遅れたのか、10年前でもできたのではないか、とは感じています。未だに訴訟の書類は紙かファクスでの提出です。スペインでは法廷の3、4カ所にビデオを付け、上訴されるとその録画記録が正規の訴訟記録として電子化された証拠などとともに上級審に行くとのことです。日本は判子と紙に依存しきるのをそろそろ止める必要がありそうです。

AI開発は「社会正義」のため

――司法へのAIの導入を人々はどう受け止めるでしょうか。

新田 米国の法律エキスパートシステムの初期の論文にはその開発動機は社会正義の実現のためと書かれていました。金持ちが有能な弁護士を雇って裁判で有利になるのではフェアではなく、だれでも簡単に法律にアクセスでき、正しく判断できることが大事です。たとえば離婚調停において妻が法律をあまり知らないために夫に不利な条件をのまされる、ということがあってはいけないのです。AIの導入により、複雑な事件でも論点の検出などにより議論の進行の助けとなれば、裁判のスピードアップに資することが期待されます。AIに裁判のすべてを任せるのは問題があると思いますが、AIを補助ツールとしてうまく使えば有用だと考えています。

太田 裁判へのAI導入について社会調査をしたことがあります。期待と不安がいずれも強いというアンビバレント(相反的)な態度がみられました。この調査では「全国一律の法的判断がなされ、裁判所や裁判官によるブレがなくなる」、「科学的に正しい事実の認定がなされる」、「嘘や不正確な証言・証拠の悪い影響がなくなる」、「公正中立な裁判となる」、「裁判にかかる費用が安くなる」、「裁判にかかる時間が短くなる」、「依頼した弁護士の能力の高低の影響を裁判が受けない」など、AI裁判に期待される事項についての人々の期待の程度を尋ねたところ、総じて高い期待を寄せていました。ところが、「AI裁判システムの不備による誤判の発生」、「AI裁判システムが外部から違法に操作される危険」、「裁判に『人間味』がなくなること」、「社会の変化に対応した裁判ができなくなる危険」、「人々の価値観・倫理観の変化に対応した裁判ができなくなる危険」などのAI裁判への懸念について心配の程度を尋ねたところ、非常に強い心配をしていました。このように、新しい技術に対して人々は高い期待と高い不安という矛盾する気持ちを持っていることがわかりました。不安材料をどうひっくり返していくかがAI支援裁判の普及にとって重要だと思います。

調停はAIが導入しやすい

――今後、実用化はどのように進むでしょうか。

太田 契約不履行とか売買代金の取り立てなどは、争われる事情も出てくる証拠もだいたい同じようなものなので、人間裁判官がわざわざ手を煩わす必要もなくなるのではないかと考えています。不都合を感じる当事者は上訴で人間裁判官にレビューしてもらえば足りるでしょう。一方、損害賠償の逸失利益や慰謝料の計算もAIはできるとは思いますが、かなり争いになる気がします。たとえば、女性の逸失利益の計算では、AIが女性の賃金の統計をとった結果、男性より女性の賃金をずっと低く算定しまうことも起こりうる。いわば、過去のデータを学ぶAIは、過去の負の遺産をそのまま再生産してしまいうるという問題があります。米国でも、裁判官の判決が無意識のうちに(ないし意識的に)人種、性別などの差別に根ざしていることがよくあり、AI がそれを学んでしまうことに懸念が出ていました。

新田 裁判の場合、単に結論を導くだけでなく、その判決理由を提示する必要があります。深層学習を用いると、精度の高い法的判断ができる可能性がありますが、その内部のパラメータを見ただけでは、人間には機械がなぜそういう結論を出すのかわからないのです。つまり深層学習とは「理由はわからないけど結論が当たる」という性質を持つのですが、裁判で、判決理由なしに結論だけ示しても、なかなか納得は得られないですよね。

太田 とはいえ、実際の裁判の判決理由では、要件事実と法的三段論法で書かれていますが、実際の判断のプロセスや本当の判断理由は、無意識や情緒など の複合としてなされていることが認知脳科学で明らかになっていて、裁判には理由が必要だというときの「理由」が「後講釈」ないし「事後合理化」でしかない要件事実と三段論法で本当にいいのか、という人間裁判官の裁判の問題に跳ね返ってきます。

――「AI裁判官」の登場には相当の時間がかかりそうですね。

新田 紛争が起きたときにすぐに裁判に訴えるのではなく、まず裁判外の調停、仲裁などの手続きを利用する、ADR(AlternativeDispute Resolution)が推奨されています。またADRをオンライン化したODRの議論は進んでいます。ODRにおいてはAIが情報検索を支援したり、簡単な相談には自動応答したり、議論の進行も支援したりすることが期待されています。より高度な機能としては、論点を整理したり、当事者双方の歩み寄りによる妥協案をつくったり、議論に基づき合意文書を作成したりといったことが考えられます。

太田 AIの導入が一番しやすいのは調停でしょうね。裁判は最終的には公的判断を一方的にかつ拘束的に示しますが、これをAIがやるとなると、適正な判断を示すための情報がまだ足りないし、人々の抵抗感もある。他方、調停は意案を当事者に対してAIが個別具体的に示すけれども、当事者が合意しなければそれまでです。当事者がそれに合意すれば調停成立です。よって、私的自治の原則のもとで当事者が合意した以上、「誤判」もありえません。AIが、過去の凡例や紛争解決事例から「こんな紛争事案にはこのような解決策が適切なのでは」と3つ、4つ提案して当事者に選んでもらう。そんなことができるのではないでしょうか。

最後は人間が判断する

――そこまでできる可能性もあるんですね。

太田 一方で、人間の裁判官にしかできない判断は引き続き残っています。たとえばインターネット時代に著作権をどのように考えるか、など新しく生じた問題が法的な形で出てきたときには、生身の人間裁判官が判断するしかない。過去の事例が存在しないので、そこからAIは学ぶことができないからです。もう一つは、一見明白に見える判断でも、社会の変化とともにおかしなものになることがあるということです。民法の除斥期間は20年ですが、たとえば不法行為の後になって後遺症が出た、再発したというとき、起算点をどこにとるか、AIには柔軟に判断できない。過去の判例に沿った下級審の判断を最高裁判所がときとして覆してきたように、最後は人間が判断しなければならないと思います。つまり、社会変化、倫理の変化、文化の変化、政治的問題など、いわゆる「ハード・ケース」(法政策的価値判断を要する事案)はどうしても人間裁判官が行うしかなく、後は国会などの政治プロセスによるレビューという民主主義社会の原則に戻ることになると思います。

――AIがときどきの社会通念などを考慮するようになれば、できる判断も変わってくるのでしょうか。

新田 今のやり方で判例データベースから機械学習をして法律判断をすると、過去の判例に沿った保守的な考え方しかできないおそれがあります。社会通念が大きく変化したときにクリエイティブな判断を行うには、判例データベースの機械学習以上のブレークスルーが必要です。

太田 仮に、あらゆるニュース、チャット、メールへのアクセスができるAIコンピュータがあって、世の中の流れをみて3年後には人々の意見はこうなるのだろうと予測し、それに基づいて判断するということはできるのでしょうかね。ウェアラブル・コンピュータができ、人間に関する膨大なデータをすべて解析することも可能な時代には、世の中の流れを先取りするAI裁判所も出現するかもしれません。とはいえずいぶん先の話でしょうけど......。

新田 それが暴走してしまう怖さがありますね。普通のコンピュータの計算能力がいずれ全人類の脳の計算能力の総和を超えるようになると言われます。しかし膨大なデータを解析できるようになったからといって、それが「賢い判断」「正しい判断」につながっているかというとわかりません。AIが自律的に正しい価値判断をできるようになれば良いのですが、今のところそれが実現する仕組みはないのです。

聞き手からのひとこと

知性だけでなく、怒りや恨みなどさまざまな感情がぶつかり合う司法の分野に、AIがどう役に立つのだろう。そんな疑問は、この分野の研究の草創期から携わってこられた両先生のお話でかなりときほぐされた。今後、全判決のデータベース化など司法のIT化が加速するなかで、訴訟記録への実質的なアクセスが確保されていないといった、今ある制度の矛盾も解決する必要を痛感した。AIが便利に使えるようになっても、やはり生身の人間の法律家にしか提供できない価値とは何か。AI時代にかなう法曹を育てていくことも、急ぎの課題なのだろう。(朝日新聞 井田 香奈子)

(photo カケマコト)